Möchte man zwei Einflussvariablen betrachten, sollten also mindestens 40 Beobachtungen vorliegen. Fehlende Werte sind ein häufiges Problem bei medizinischen Daten. Sobald bei einer der Einflussfaktoren oder bei der abhängigen Variable ein Wert fehlt, wird diese Beobachtung aus der Regressionsanalyse ausgeschlossen.Sie wird angewandt, wenn geprüft werden soll, ob ein Zusammenhang zwischen zwei intervallskalierten Variablen besteht. "Regressieren" steht für das Zurückgehen von der abhängigen Variable y auf die unabhängige Variable x. Daher wird auch von "Regression von y auf x" gesprochen.Die logistische Regressionsanalyse wird immer dann angewendet, wenn das Kriterium nominalskaliert und nicht mehr metrisch ist. Das bedeutet, dass die abhängige Variable verschiedene Ausprägungen haben kann. Als Beispiel kann ein Examen betrachtet werden, das die Ausprägungen „bestanden“ oder „durchgefallen“ aufweist.

Wie viele Variablen in Regression : Kategoriale Variablen können nur ohne ohne Weiteres in die Regression aufgenommen werden, wenn sie zwei Ausprägungen haben (daher: dichotom sind, wie ja/nein, männlich/weiblich, etc.), die mit 0 und 1 kodiert wurden. Bei mehr als zwei Ausprägungen müssen die Variablen vorher Dummy-Kodiert werden.

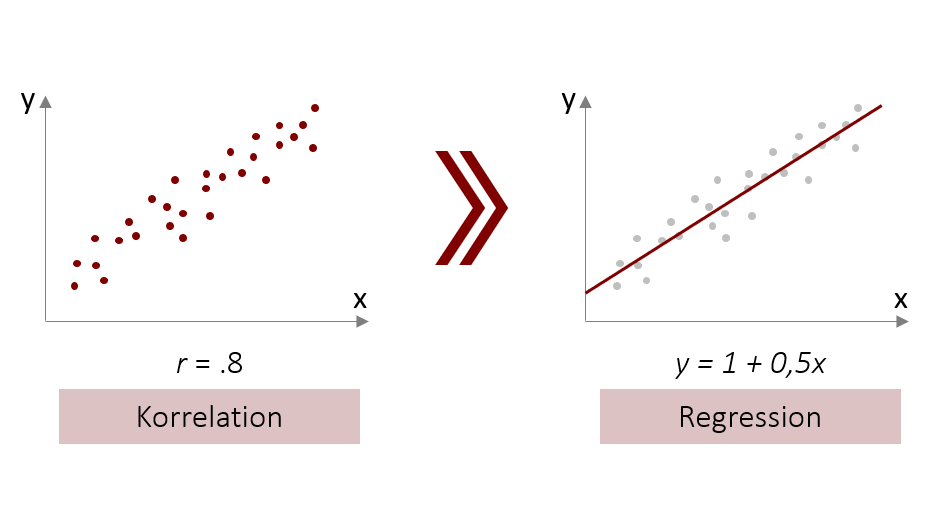

Wann Korrelation und wann Regression

Die Korrelation beschäftigt sich mit der Frage nach dem Zusammenhang zwischen zwei Variablen. Die Regression nutzt diesen Zusammenhang, um Werte der einen Variable auf Basis der Werte der anderen Variable vorherzusagen.

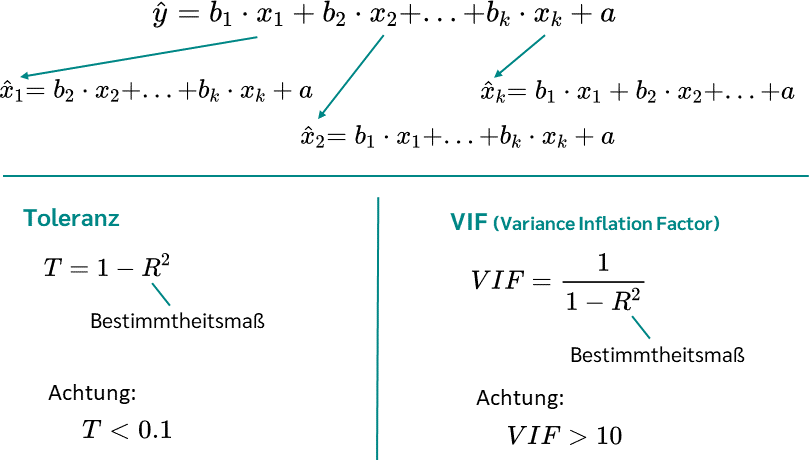

Warum multiple Regressionsanalyse : Während du bei der einfachen linearen Regression nur einen Prädiktor betrachtest, verwendest du bei der multiplen linearen Regression also mehrere Prädiktoren, um das Kriterium zu schätzen. Das hat den Vorteil, dass du mehrere Einflussfaktoren gleichzeitig in deiner Vorhersage berücksichtigen kannst.

Eine Regressionsanalyse ist nur dann sinnvoll, wenn ein echter kausaler Zusammenhang zwischen zwei Zufallsvariablen besteht. Worüber sagt die Korrelationsrechnung etwas aus Die Korrelationsrechnung sagt etwas über Stärke und Richtung des Zusammenhangs zwischen den Zufallsvariablen X und Y aus.

Möchtest du nur eine Variable zur Vorhersage verwenden, kommt eine einfache Regression zur Anwendung. Ziehst du mehr als eine Variable heran, handelt es sich um eine multiple Regression. Ist die abhängige Variable nominal skaliert muss eine logistische Regression berechnet werden.

Welche Variablen für Regressionsanalyse

Formen der Regressionsanalyse

| Form der Regressionsanalyse | Mögliche Merkmale der Variablen |

|---|---|

| einfache lineare Regression | AV: 1 UV: 1 |

| multiple lineare Regression | AV: 1 UV: min. 2 |

| (binäre) logistische Regression | AV: 2 UV: min. 2 |

| multinominale logistische Regression | AV: min. 3 UV: min. 2 |

Nur im Falle eines linearen Zusammenhangs ist die Durchführung einer linearen Regression sinnvoll. Zur Untersuchung von nichtlinearen Zusammenhängen müssen andere Methoden herangezogen werden. Oft bieten sich Variablentransformationen oder andere komplexere Methoden an, auf die hier nicht einge- gangen wird.Korrelationsanalyse nach Pearson

Der Wert -1 gibt an, dass ein gänzlich negativer linearer Zusammenhang besteht (je mehr, desto weniger). Bei einem Wert von 0 liegt kein linearer Zusammenhang vor, die Variablen korrelieren nicht miteinander.

Während du bei der einfachen linearen Regression nur einen Prädiktor betrachtest, verwendest du bei der multiplen linearen Regression also mehrere Prädiktoren, um das Kriterium zu schätzen. Das hat den Vorteil, dass du mehrere Einflussfaktoren gleichzeitig in deiner Vorhersage berücksichtigen kannst.

Welche Regression ist am besten geeignet : Die Verwendung der kategorialen Regression ist am besten geeignet, wenn das Ziel der Analyse darin besteht, eine abhängige (Antwort-)Variable aus einem Set unabhängiger (Prädiktor-)Variablen vorherzusagen.

Was brauche ich für eine Regressionsanalyse : Voraussetzung für die lineare Regressionsanalyse

Zwischen den Variablen besteht ein linearer Zusammenhang. Das Skalenniveau der AV und UV sollte metrisch sein, sprich einen konkreten Zahlenwert besitzen. Ein Beispiel dafür ist die Körpergröße.

Wann nicht lineare Regression

Ebenso wäre z.B. eine Regressionsfunktion mit Regressoren x-1 oder ex nicht-linear in den Variablen. Eine Regressionsfunktion ist nicht-linear in den Parametern, wenn sie Koeffizienten wie b-1 oder b2 enthält. zu einer Funktion, die linear in allen Parametern und Variablen ist.

Daher werden Korrelationen normalerweise mit zwei Kennzahlen geschrieben: r = und p = . Je näher r bei Null liegt, desto schwächer ist der lineare Zusammenhang. Positive r-Werte zeigen eine positive Korrelation an, bei der die Werte beider Variable tendenziell gemeinsam ansteigen.Bei der linearen Regression ist die Voraussetzung, dass das Skalenniveau der abhängigen Variable intervallskaliert ist, sowie eine Normalverteilung vorliegt. Ist die abhängige Variable kategorisch, wird eine logistische Regression verwendet.

Wann lineare und wann multiple Regression : Während du bei der einfachen linearen Regression nur einen Prädiktor betrachtest, verwendest du bei der multiplen linearen Regression also mehrere Prädiktoren, um das Kriterium zu schätzen. Das hat den Vorteil, dass du mehrere Einflussfaktoren gleichzeitig in deiner Vorhersage berücksichtigen kannst.